OpenAI 推出 AI 圖片檢測工具,識別準確率高達 98%

隨著AI生成的圖片、視頻越來越“真”,識別互聯網信息來源和真實性的需求正變得愈發迫切。

當地時間周二,美國科技公司OpenAI發布公告稱,為了區別照片是由相機還是自家AI生成的,公司推出了一款圖像檢測分類器——用來分析一幅圖像是由OpenAI的“文生圖”工具DALL·E 3生成的概率。公司從周二開始接受研究人員訪問該工具的申請。

識別成功率頗高

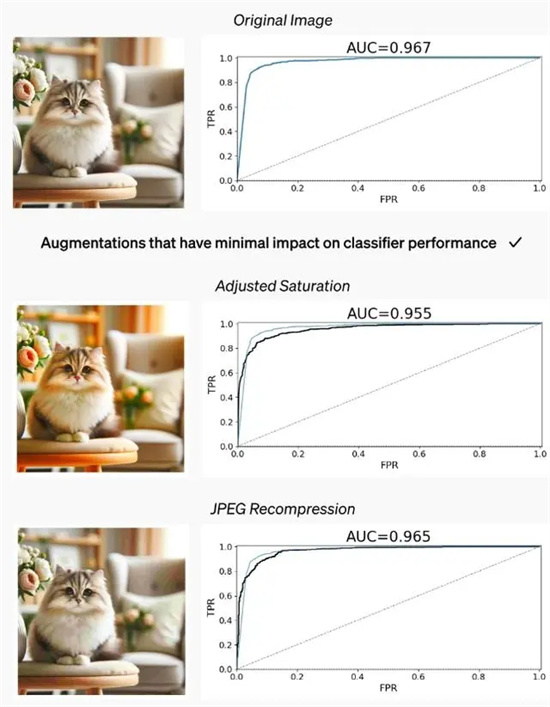

OpenAI介紹稱,在內部對分類器進行的早期測試顯示,該工具在區分非AI生成圖像與DALL·E 3生成的圖像方麵成功率很高,成功率能夠接近98%,同時隻有少於0.5%的非AI圖像被錯誤地標記來自DALL·E 3。同時這個工具能夠應付一係列常見的修改,例如壓縮、裁剪和修改圖像飽和度。

然而,這項工具也有局限性,也顯示出“識別AI”這條路才剛邁上第一步。OpenAI透露,如果對圖片進行一些微小的修改,就可能會擾亂工具的可靠性。同時,該工具在區分DALL·E 3與其他AIGC工具的產出方麵也表現不佳。不過OpenAI也強調,開發這個工具的意圖本來就不是用來檢測其他熱門工具(例如Midjourney)生成的圖像。

OpenAI的政策規劃主管大衛·羅賓遜對媒體表示,鑒於2024年是美國的選舉年,選舉問題絕對是推動這項工作(識別AI產物)的主要動機,這是公司從政策製定者那裏聽到的頭號擔憂。

從最新進展來看,識別AI圖像的前景要明顯好於分辨AI生成的文字。OpenAI曾在去年推出過一個檢測AI生成文字的工具,但識別準確率低到讓公司自己都強調“這個工具不可靠”。

OpenAI的AI政策研究員Sandhini Agarwal也表示,對於大選年的“深度偽造”泛濫問題,新的識別工具可能有助於遏製這種情況,但不會根治問題。Agarwal強調,在打擊“深度偽造”方麵,壓根就沒有靈丹妙藥。

從源頭解決問題:給AI打數字水印

除了通過識別最終作品來判斷是否由AI生成外,解決這個問題還有一個更直接的方法:在工具生成圖片、視頻時就打上“AI水印”,後續隻需要識別圖片是否存在這類標記即可。

OpenAI也在周二宣布加入了C2PA的指導委員會。

C2PA的全稱是內容出處和真實性聯盟(Coalition for Content Provenance and Authenticity),旨在製定技術標準來對抗網絡上的誤導信息。其中也包括被稱為“內容證書”的防篡改元數據,展示內容是如何被創建或修改的。微軟、Meta、穀歌、索尼、Adobe等公司也是指導委員會的成員。

OpenAI確認,從今年早些時候開始,已經向由DALL·E 3 、ChatGPT和OpenAI API創建和編輯的圖像中添加C2PA元數據。等到“文生視頻”模型Sora大規模推出後,也將向產出添加C2PA元數據。

公司表示,使用者無法輕易偽造或者更改此類信息,這將使其成為建立信任的重要資源,相信這種元數據能夠成為填補數字內容真實性的關鍵空白。

相關文章

更多+手遊排行榜

- 最新排行

- 最熱排行

- 評分最高

-

角色扮演 大小:1.9GB

-

休閑益智 大小:876.69MB

-

休閑益智 大小:36.03MB

-

角色扮演 大小:1.92GB